Robot, opportunità o minaccia?

Elon Musk, ceo di Tesla e SpaceX, è intervenuto nella discussione riguardo il pericolo di una guerra nucleare, uno scenario reso possibile dalle frequenti minacce del leader nordcoreano Kim Jong-un, ma non nel modo che ci si aspetterebbe: “La Nord Corea – ha sostenuto – dovrebbe occupare un posto molto basso nell’elenco delle nostre preoccupazioni”. Musk è infatti convinto che “un nuovo conflitto internazionale potrebbe essere avviato non dai leader dei vari Paesi ma da uno dei loro sistemi di intelligenza artificiale”. È quindi l’intelligenza artificiale a doverci preoccupare sul serio? A suo dire la corsa all’equipaggiamento di tecnologie avanzate potrebbe portare un paese a intraprendere azioni belliche nei confronti degli avversari, nel caso le forme di intelligenza artificiale suggerissero (o decidessero) che un attacco preventivo sia la mossa più logica per la vittoria.

Da sempre preoccupato per i risvolti dell’impiego dell’intelligenza artificiale è l’astrofisico Stephen Hawking secondo il quale, nonostante consideri l’AI come uno dei più grandi eventi della storia umana, non possono escludersi conseguenze catastrofiche di un’autonomia e dello sviluppo, da parte di robot, di una propria coscienza in contrasto con la nostra. Entusiasta è invece Mark Zuckerberg, fondatore di Facebook, che prospetta un pacifico quadro di convivenza con l’intelligenza artificiale che, se usata nel modo giusto, “renderà la nostra vita migliore”. Un ottimismo condiviso dall’ex scettico Bill Gates, ora meno preoccupato dato l’enorme progresso che si sta registrando nel campo.

Le preoccupazioni circa l’impiego dell’intelligenza artificiale non si limita al solo mercato del lavoro nel timore di una sostituzione di massa dei lavoratori con le macchine (argomento che su queste pagine abbiamo ampiamente trattato con Galassia Lavoro), ma investe soprattutto le scelte politiche nonché etiche più ampie, perché il vero problema – secondo gli esperti – è lo sviluppo crescente dell’autonomia delle macchine, fino ad una libertà che potrebbe eludere il controllo umano.

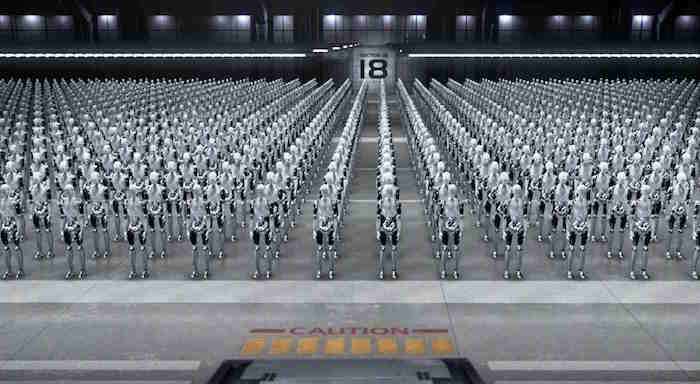

Tra le possibilità su cui si sta ragionando, quelle più controverse riguardano l’ambito bellico e la politica, in questo caso da intendersi come “luogo delle decisioni”. In particolar modo la guerra, pone in primo piano una questione etica sulla “correttezza” dell’impiego di robot dotati di autonomia per uccidere. Forme di intelligenza artificiale sono già in uso nel settore bellico, ad esempio i droni senza pilota, in grado di individuare la presenza di nemici o altri tipi di tecnologie simili, che si arrestano solo ad operazione conclusa. In più torna il timore di cui si accennava prima: e se le macchine invertissero i ruoli di comando?

Gli stessi governi, consapevoli della portata del fenomeno e dell’impatto in termini di potere e leadership, investono non poco nell’intelligenza artificiale. Secondo il presidente russo Vladimir Putin “chi svilupperà la migliore intelligenza artificiale, diventerà il padrone del mondo”, perché in grado di controllare uno strumento ad alto potenziale e in possesso di una maggiore forza bellica e contrattuale rispetto agli altri paesi. L’ampiamento delle conoscenze e della capacità di un algoritmo di discernere tra le opzioni quella più logica, potrebbe comportare il suo impiego quale decision maker ai tavoli internazionali. Fantascienza? Difficile a dirsi, ma non impossibile.

Sul tema è stato di recente redatto il parere su Sviluppi della robotica e della roboetica del Comitato nazionale per la Bioetica e il Comitato Nazionale per la Biosicurezza, le Biotecnologie e la Scienza della Vita (luglio 2017). «Il problema etico della robotica militare – si legge sul documento del CNB e del CNBBSV – è essenzialmente quello della responsabilità. Il controllo è fino a un certo punto, perché qualsiasi arma, per quanto “chirurgica” o “intelligente” possa essere, ha un range di distruzione incontrollabile, e la responsabilità del suo impiego ricade, a vari livelli, su tutta la catena operativa, dalla progettualità alla fabbricazione a chi ne decide l’impiego fino all’ultimo operatore che la comanda o telecomanda. Il robot, nelle migliori condizioni della programmazione, potrà essere “rispondente” non certo “responsabile”». Per questo motivo, in ambito giuridico, sarebbe opportuno «prevedere in merito alla responsabilità giuridica dei robot, fin d’ora, delle tutele e garanzie per i cittadini, per gli utenti e per le imprese, al fine di evitare, nella misura del possibile, che la condotta dei robot possa cagionare danni, considerato che non si tratta tanto di creare leggi per i robot intelligenti, ma di creare regole per gli umani che a tali macchine si affidano per ampliare le proprie capacità, qualunque esse siano».

A mettere dei paletti, in effetti, è già intervenuto il Parlamento europeo che ha richiesto alla Commissione di proporre norme comunitarie per rispettare standard etici e legali in caso di danni procurati da intelligenze artificiali. Il progetto di legge dovrà prevedere a chi attribuire la responsabilità in caso, ad esempio, di incidente con un mezzo senza conducente. Più complesso (e a lungo termine) è invece stabilire se e come concedere uno status giuridico ai robot in modo da riconoscerli come “persone elettroniche responsabili”, questione che diverrà necessaria se diamo per scontati e rapidi i progressi tecnologici, cioè l’ipotesi di convivere con robot in grado di prendere, vagliando tutte le opportunità, delicate decisioni circa le sorti di intere nazioni o dell’economia globale.

È presumibile anche, però, che i timori siano almeno ad oggi infondati. È davvero possibile immaginare un mondo in cui – seguendo gli schemi della politica – sia da mettere in conto l’eliminazione di elementi fondamentali quali l’intuito, la fiducia, il bluff e il pensiero ponderato dell’uomo?